Tecnología

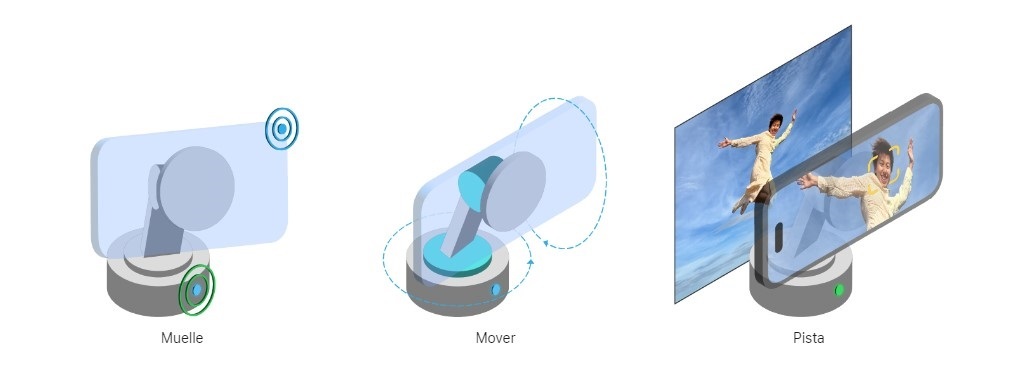

Apple presenta DockKit, que habilita nuevas posibilidades de grabación y seguimiento en vivo con iPhone

Tecnología

OpenAI lanza GPT-4o mini, un modelo más ligero y económico

Tecnología

Google anuncia limpieza de apps en Play Store: retirará las que no cumplan unos mínimos de funcionalidad y contenido

Tecnología

Files de Google permitirá comprimir carpetas y archivos

-

TecnologíaHace 3 años

TecnologíaHace 3 añosXiaomi lanza en España el Redmi Note 12 Pro + 5G desde 499,99 euros con cámara de 200MP y carga rápida de 120W

-

BoliviaHace 5 años

ROSITA POCHI, JERARQUÍA Y RITUALIDAD GUARANÍ

-

TecnologíaHace 1 año

TecnologíaHace 1 añoMeta agrega voz y nuevas capacidades de generación de imágenes a su asistente Meta AI en WhatsApp, Instagram y Facebook

-

EconomíaHace 3 años

EconomíaHace 3 añosSeis tips para organizar tu viaje de vacaciones sin gastar de más

-

EconomíaHace 2 años

EconomíaHace 2 añosRepresentantes de CAINCO se reúnen con el presidente Luis Arce para manifestar su preocupación por la situación económica del país y trabajar en soluciones conjuntas.

-

EconomíaHace 2 años

EconomíaHace 2 añosLa UE invertirá 45.000 millones de euros en América Latina y el Caribe

-

EconomíaHace 2 años

EconomíaHace 2 añosCAF cerró el 2023 con récord de USD 16.201 millones en aprobaciones

-

EconomíaHace 2 años

EconomíaHace 2 añosCAF emite en Europa el bono más grande en su historia por EUR 1.500 millones